【人工智能与机器人研究】基于ROS的多传感器融合巡检机器人系统研究

导读

商场、写字楼等室内场所经常存在异物堆放和发生火灾烟雾的情况,这些室内场所作为重要的活动区域,为了消除存在的安全隐患。需要经常对商场、写字楼等室内场所进行巡检,然而人工巡检效率低下,且不能全天候巡检。智能巡检机器人能够高效、全天候对巡检区域进行巡检。设计研究基于多传感器融合的ROS巡检机器人,该巡检机器人包括对激光雷达数据的预处理,基于粒子滤波的Gmapping算法实现建图,AMCL用于室内巡检机器人的重定位。结合A*全局路径规划算法和DWA局部路径规划算法共同实现室内巡检机器人的导航避障。深度相机结合改进YOLOv7检测算法对室内是否存在火灾烟雾与行人依靠电梯等安全隐患进行巡检。实验表明:该室内巡检机器人具有良好的建图、导航避障、视觉检测的功能。可见研究成果对室内巡检机器人的研究具有一定参考价值。

正文

该巡检机器人基于ROS开发平台,采取分层化和功能模块化设计的思路,建立起多传感器融合的ROS巡检机器人的系统框架,其总体架构如图1所示。架构总共分为5个层次:主要是控制层、ROS系统层、驱动层、PL层、机器人硬件层。

如图1所示,控制层是运行于系统服务器端的,通过WIFI局域网建立PC端与ROS巡检机器人进行通讯。在PC端编写相关的算法程序,利用机器人中的Jetson Nano开发板进行数据采集与处理与算法实现,并且具有远程可视化界面,实现人机交互,便于远程监控与运动控制。驱动层主要是涉及到电机等外设驱动与深度相机、激光雷达驱动,相关的传感器主要是通过I/O扩展与Type-c进行连接,并进行相关数据传输。

该巡检机器人的底盘结构如图2所示,并且使用四个麦克纳姆轮作为驱动轮,可以在各种复杂的环境进行纵横向自由移动,相较于传统的机器人的机动性更高。同时四驱轮平台架构效率更高,编写控制运动代码较为简单,相关计算量较小,增加了机器人定位和自主导航的准确性。

巡检机器人硬件部分如图3所示,由麦克纳姆轮、Asttra pro Plus摄像头、思岚S2激光雷达、直流电机等组成。开发板采用STM32和Jetson Nano。

软件部分主要包括ROS巡检机器人的上位机界面的设计与机器人建图定位与自主导航、路径规划算法以及检测等相关算法的设计。在Ubuntu16.04系统中进行实现。主要是负责对算法的处理以及多传感器融合计算,其中包括深度相机、激光雷达驱动控制、同各个开发板保持实时话题通讯等。大致框架如图4。

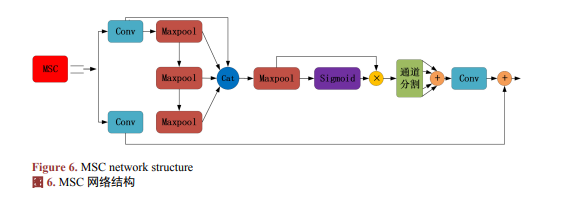

视觉检测模块使用改进的YOLOv7的RGB图像目标检测方法,其主要结构如图5所示。它的主要改进原理是结和COT (Contextual Transformer)结构,改进YOLOv7主干,指导动态注意力矩阵的学习,增强视觉表征能力。其次,在主干网络的第一个池化层后面添加了MSC模块,扩大感受野,更好地理解全局特征信息,提高检测精度;最后在头部网络的特征融合部分添加了三维SimAM注意力机制,能够对不同通道和空间位置的神经元分配不同的注意权重。在不增加参数的情况下,避免结构复杂化,利用该注意力机制加强目标在提取特征中的权重并抑制背景干扰权重,从而提升模型检测性能。

其次为了减小MSC模块的参数量,将得到的特征图沿通道方向分成4个特征图。随后,将这些特征映射回拼接操作前的大小,然后对它们进行拼接,以进一步扩展图像的感受野。接下来,通过应用1 × 1卷积来增加通道的数量,从而控制网络的通道数量,有效控制模型的复杂性。最后,引入残差结构,缓解YOLOv7网络层较深导致梯度消失的问题,提高网络识别目标任务的泛化能力。结构如图6所示。

如图7所示,该导航框架中的传感器等相关节点都是基于机器人硬件平台提供,主要用于反馈环境信息、坐标转换信息、运动信息等。MOVE_BASE框架中的全局代价地图、局部代价地图和恢复行为这三个模块主要用于辅助机器人整个自主导航过程中的路径规划以及运动控制。

在开源数据集LLVIP中,分别对YOLO系列算法进行对比实验,实验数据见表2。使用改进的行人检测网络训练出的模型准确率高达96.3%,在参数量和计算量都相较于各系列YOLO算法平均减少了25.1%。

结论

该机器人能够完成建图与自主导航,并且能够准确检测到行人依靠电梯危险行为和火灾烟雾等突发情况。实现对商场等室内场所的部分重点区域进行全天候无人智能巡检,该研究为巡检机器人行业提供了一种可靠的方案。

基金项目:

自然科学基金资助项目(62063009);

国家重点研发计划(2023YFB4302100);

江西省重大科技研发专项(20232ACE01011);

中国科学院赣江创新研究院自主部署项目(E255J001);

原文链接:基于ROS的多传感器融合巡检机器人系统研究